On va être cash: la NSA adore creuser dans la vie privée. Depuis des années, cette agence américaine fait tout pour collecter, croiser et stocker des données sur nous tous. Big Brother version XXL, tu vois le tableau ? Des spécialistes ne s’en cachent pas: le but, c’est d’avoir une sorte de double numérique pour chaque personne.

Mais c’est quoi, ce fameux double ? Imagine une immense ombre digitale qui te suit partout, construite à partir de tes messages, achats, déplacements, discussions… tout ce qui te rend unique, capté grâce aux projets moteurs de la surveillance de masse type PRISM ou à des centres comme Utah Data Center.

“On veut tout savoir, tout anticiper, et tout stocker pour longtemps” expliquent des analystes sécurité dans leurs ouvrages.

La NSA ne s’est pas lancée là-dedans par hasard. Après la guerre froide, il fallait contrôler les menaces, mais aussi prévoir les comportements, analyser les liens, comprendre les réseaux… et pourquoi pas, influencer le monde.

Des journalistes révèlent que tout a démarré par des infos glanées sur le web, puis l’installation de centres de stockage gigantesques.

Voilà où le projet de double numérique commence à se constituer: au fil des technologies et des petits boulots de la surveillance, les données s’agrègent, les profils se dessinent, et le grand réseau se forme.

Entre chaque étape, la curiosité et l’inquiétude grandissent. La NSA joue la carte du secret, mais laisse parfois filtrer des intentions à travers des discours ou des fuites.

Accroche-toi, la suite te montrera que derrière ce réseau, il y a bien des cerveaux qui pensent à très long terme… et sûrement avec des objectifs moins avouables que “protéger la population”.

Les technologies derrière le double numérique

Prépare-toi: pour créer un double numérique, la NSA ne rigole pas côté techno. D’abord, elle pioche dans l’Internet des objets, le big data et l’intelligence artificielle pour tout capter, tout analyser.

Ces experts expliquent comment chaque capteur, chaque appli qui se connecte à internet nourrit le fameux profil digital.

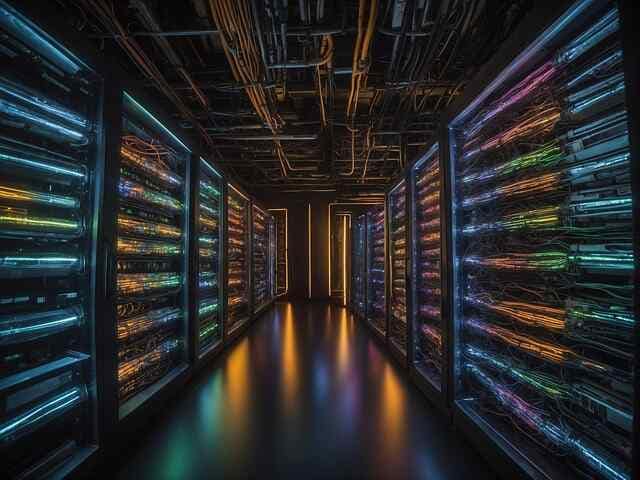

Tes infos ne dorment pas sur ton téléphone: elles filent dans des centres de stockage géants, genre Utah Data Center ou Oak Ridge. Ces endroits, blindés de serveurs, stockent des milliards de singes de données. Certain évoque même le stockage sur ADN pour que les infos tiennent… des siècles.

“Ce n’est pas juste archiver, c’est organiser un puzzle permanent, à l’échelle mondiale” glisse un analyste.

La NSA ne se contente pas d’accumuler, elle relie les points. Des algorithmes créent des liens entre les données, dessinent des cartes des réseaux et anticipent les futures relations. À force de tout connecter, le double numérique devient vivant, évolue chaque jour, et peut même “apprendre” de tes nouveaux choix ou habitudes.

Des journalistes le détaillent dans des enquêtes très fouillées.

Comment le réseau devient une machine bien huilée pour le futur

Et là, ça devient dingue. À force de réunir toutes les données, la NSA construit un vrai réseau organisé où chaque “double” alimente la grande intelligence commune. L’objectif ? Prédire, influencer, contrôler au fil du temps.

Des publications comme Nature montrent que c’est un système qui anticipe tes mouvements, tes achats, tes choix, en mode prévision météo version humaine.

“Le réseau digital, c’est la toile qui attrape chaque interaction, pour la transformer en scénario d’avenir” souligne un spécialiste.

Derrière ces technologies, tu trouves des équipes mixtes: ingénieurs, analystes, stratèges. Chacun bosse pour que le réseau reste invisible, mais ultra-puissant. Les données, triées et recoupées chaque jour, forment la base d’un système de surveillance mondiale — avec tous les risques que ça suppose si le contrôle vient à manquer.

Les projets de départ étaient simples : protéger contre le terrorisme, surveiller quelques suspects. Mais aujourd’hui, c’est toute la planète qui se retrouve dans le viseur numérique.

Suspense garanti: qui pourra freiner ou orienter cette machine dans les prochaines décennies ? Quelle part de nos vies passera sous le radar du double numérique ?

Les impacts à moyen et long terme

C’est là que l’affaire se corse. Le double numérique de la NSA transforme la vie privée en champ de bataille.

Les experts en surveillance tirent la sonnette d’alarme: le risque de dérives est énorme.

“Le contrôle algorithmique, ce n’est pas un scénario futuriste, c’est déjà le présent pour des millions d’individus” souligne une chercheuse.

À moyen terme, nos libertés publiques s’érodent, l’identité numérique devient un objet marchand entre grands acteurs tech. Et si le système déraille ou se fait pirater ? C’est la catastrophe pour chacun d’entre nous, et personne ne pourra revenir en arrière.

Sur le long terme, c’est la démocratie elle-même qui tremble. Plus de contrôle, moins de transparence, et une dépendance constante au jugement d’un algorithme.

Des études montrent que la société glisse vers l’ultra-surveillance où chaque geste est analysé et prédit.

Suspense total: à quoi ressemblera notre avenir si le “double numérique” devient la norme ? Prépare-toi, parce que le réel pourrait vite dépasser la fiction.

Démasquer ou consentir ? Le vrai enjeu

Et maintenant, on fait quoi ? Sommes-nous justes des victimes ou complices consentants du grand réseau de surveillance ? Les lanceurs d’alerte, comme Edward Snowden, nous poussent à ouvrir les yeux sur la réalité des technologies collectées et stockées en silence.

“La seule solution, c’est d’en parler, d’en débattre, de réclamer des règles pour ne pas finir dans un monde sans contrôle humain” affirme un spécialiste de l’éthique numérique.

La balle est dans notre camp: rester passifs, c’est prendre le risque de glisser dans une société où le double numérique gère tout sur nous.

Mais en posant les bonnes questions, en exigeant des lois claires et des garde-fous, on peut garder la main… au moins un peu.

Parce que le suspense, il n’existe que si on participe à l’histoire. À toi de jouer.